60岁老太“半夜玩游戏”被17次人脸识别,危险何在?

原创:刘远举 南都观察家,上海金融与法律研究院研究员

既然防止熊孩子打游戏这件既不迫切、又不紧急、没有危险的事情都可以上人脸识别,那就没有什么事不可以上人脸识别了,也没有什么不可以用技术监管了。

近日有网友发帖称,自己在玩热门游戏“王者荣耀”时,发现“一名60岁老太太,凌晨三点还在玩游戏”。腾讯随后回应称,经过近3天的筛查比对,“老太太”的这个账号已被找到。该账号因屡次被判定为“疑似未成年人”,前后共计17次触发了人脸识别验证,但全数通过。从技术手段和实际验证看,系统认为确系“老太太本人”在玩游戏。至于是否怀疑中的“小孩子要奶奶或外婆代刷脸”,腾讯表示无法判断——这也很合理,毕竟企业不能打电话到派出所或社区叫人上门去查,也不能在用户家里装个摄像头。

然后,这件事情就作为社会新闻结束了,舆论放过了真正应该深究的问题:刷脸。在类似案例中,这样做是否符合法律原则?如果答案为是,其必要性和合理性何在?它看起来是个简单的操作,但背后涉及的问题和理念很复杂、很敏感。

▌人脸识别涉及个人隐私,很敏感

密码丢失(遗忘)了,可以再设置,但指纹、人脸、虹膜、声纹等生物信息对任何个人来说,都是独一无二的。虽然不像密码那样容易遗忘,可一旦泄漏,就会永久失去这一信息的私密性,从而失去保密功能。

为此,各国都有严格的法律来保护人脸识别这样的个人信息。如欧盟地区的数据保护法《通用数据保护条例》(GDPR)就规定,面部图像(facial image)构成特殊类型个人数据下的“生物识别数据”,进而相较于一般个人数据,受制于更高的保护要求。中国全国人大常委会也在8月20日表决通过了《个人信息保护法》,其中也对人脸、指纹、虹膜等等个人敏感信息保护做出了专门规定,被称为中国版的GDPR,该法律将于2021年11月1日施行。

即便如此,公众对人脸信息的读取和储存依然疑虑重重。受信息保护法律的限制,欧美国家有很多相关的项目或是自愿、或是被迫叫停。微软目前已悄然删除其最大的公开人脸识别数据库——MS Celeb。IBM宣布终止人脸识别业务,关停相关技术研发,旧金山、马萨诸塞州赛默维尔市、加州奥克兰市等也相继宣布禁止人脸识别技术,欧盟打算在未来3-5年禁止在公共场所使用人脸识别技术,瑞典与美国教育部也叫停了学校人脸识别项目。

9月5日,中国教育部科学技术司司长雷朝滋在接受采访时说,人脸识别进校园,既有数据安全也有个人隐私问题……对学生的个人信息要非常谨慎,“能不采集就不采,能少采集就少采”。前段时间,南京市住房保障和房产局紧急叫停了售楼处的人脸识别。《天津市社会信用条例》也有相关规定。

▲ 为了对付售楼处的人脸识别系统,有人想出了戴头盔看房的奇招。 © CCTV

虽然人脸信息非常敏感,但人的需求多种多样,安全并不是压倒一切的需求,有时方便也很重要。正如中国某互联网公司董事长所说,“中国人对隐私问题更加开放,会愿意用自身隐私来换取更便捷的互联网服务”。当时该言论曾引起轩然大波,然而从实际来说,密码容易遗忘和被盗,加之输入操作麻烦,在既要安全也要方便的场景下,人脸识别的确是个不错的解决方案,比如小额支付、出行安检、门禁、智能家居等等。

但人脸识别的边界在哪里?在游戏账号认证案例中,谁应该承担主要的职责?网络游戏平台在监管未成年人限时上网过程中,是否一定要刷脸?答案是不一定。该不该刷脸认证身份,要从不同人群的责任与义务、收益与成本的角度去考虑。

▌账号识别的责任

蜘蛛侠里说,能力越大,责任越大。这并不是凭空的文艺创作或口号。法律经济学里有一个汉德公式,专门用来界定不同人群的责任大小:谁能更容易、更低成本地避免事故,谁的责任就大;相反,谁更难避免事故,谁避免事故的成本更高,谁的责任就小。从某种意义上说,就是一个经济学中投入-产出比的问题。我们一直追求的是用尽量少的投入,获得尽量高的收益。比如商场才拖了地,要防止人们因地滑而摔倒,避免滑倒成本最低的方式,就是商场树个提示牌,而不是让所有的人,随时都小心翼翼地看着地面。再比如,有人承包了鱼塘,就该将之用铁丝网围起来,以免小孩落水,而不是让所有的小孩自己注意安全。

回到游戏,防止成人账号被未成年人冒用,对家长来说非常简单:设置一个密码,打死不告诉孩子就行。

即便疑似冒名了,也没啥大不了,又没有生命危险,又不危害家人,第二天给这个手机发几个确认短信就行了,有必要人脸识别吗?

行政法的六大基本原则之一,就是比例原则。这是指行政主体实施行政行为,应兼顾行政目标的实现和相对人权益的保护。如为实现行政目标,可能对相对人权益造成某种不利影响,应使这种不利影响限制在尽可能小的范围和限度内,保持二者处于适度的比例。简单地说,就是当有多种可供选择的手段可以达到目的,应该尽可能采取损害最小、最温和、风险最小的手段,杀鸡不能用牛刀。

在游戏用户身份认证场景中,既然没有穷尽其他所有认证手段,为什么一上来就是读取、保存和调用这样敏感的人脸信息?更何况,中国的个人数据泄漏并不少见,为玩游戏就冒着人脸、指纹等私密信息泄漏的风险,这符合上述“比例原则”吗?显然是否定的。

▲ 人脸、指纹、虹膜等生物学特征都是个人敏感信息。 © Pixabay

然而,现在平台的解决方案成本由所有打游戏的人来承担。你打游戏的时候,时不时会突然跳一个人脸识别,你得一次次地刷脸,既费事,又有泄漏个人隐私的危险。如果说大部分场合隐私被用来换取方便,但在这里,你得到了什么?你什么都没得到,只是因为那些不负责任的家长没承担自己应有的监管责任,他人就得承担麻烦与风险。

经济学中有“搭便车”的理论,即你没有为某事付出成本,但是可以“搭别人的便车”,享受同样的利益。在这里,却是一个反向便车,你没有做错什么,没疏于管教孩子,让孩子盗用成人账号玩游戏,但是有人这样,为此引发的后果(平台加强监管,增加认证次数),却是由你和更多无辜的人承担。

人脸识别的成本,除了隐私泄漏风险,还有一些更现实的麻烦。

刷脸的时候,虽然屏幕上只显示脸,但实际拍摄范围大得多。周末,夜深人静,你穿着三点式,甚至没穿衣服,躺在床上打游戏,突然跳出一个对话框,要你开启摄像头做人脸识别。你不知道人脸识别的拍摄范围,刷脸时你的整个身体或许都被拍了。虽然一般来说,大公司信息保护相对较好,但小公司呢?说不定个别程序员值班时,就在“欣赏”后台存储的各种人脸识别图片。

▌技术和监管可以解决一切问题吗?

在中国,只要出现一个问题,很多人的第一想法是,“要管起来”、“就是需要管”。而且“管”的主体,一定是自己之外的客体:政府、企业/平台。很少会有人反思:“我在其中的责任是什么?我可以为此做什么?”对孩子也一样,“这孩子需要管”,“老师你好好管教”,“为什么政府不管孩子沉迷游戏/追星……”

而到了今天,有了互联网和技术手段的加持,种种监管更是如虎添翼。摄像头、录音、位置定位、大数据比对,任何一个人在互联网面前,几乎都是透明的。但我们很少讨论,仅靠技术手段能解决一切问题吗?

如果能解决,就不会有“60岁老太太凌晨三点玩游戏”这种事情了。

而通常的管理思路是:出现问题——用技术管理解决它——问题没解决/产生新问题——用更多的技术管理解决它……无限循环,却不去反思真正的原因,从根源上解决问题。

平台和监管机构滥用人脸识别,当然有其追求效率、节省成本的一面,并非没有一点合理性。但从公众角度,某种程度上,在游戏认证中采用人脸识别的手段,是被舆论喊出来的。做家长的,不愿自己承担教育孩子的责任,不愿意从教育学、心理学角度分析孩子沉迷游戏的原因,不愿意花时间陪伴孩子、改善亲子关系,而只是粗暴地要求“政府/平台管管孩子”。

其实,这又岂止于对孩子玩游戏的监管?

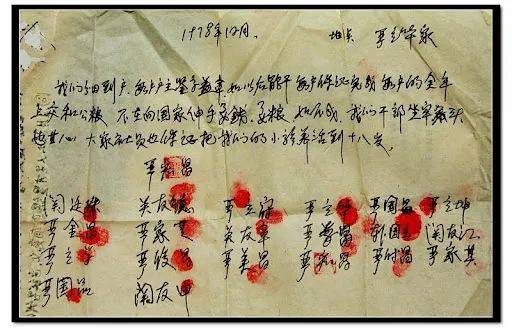

中国的改革开放,某种角度,就是放开管制,给人民自由。但与此同时,公民也要为自己负责。然而,很多时候,大家不愿意或不知道如何为自己负责,人们愿意放弃隐私和自由,换别人为自己负责。这就是所谓中国老百姓不重视隐私,服管的原因之一。

▲ 1978年,为了将土地包干到户,自己决定如何种地,安徽小岗的18位农民需要签下生死状。 © 现存国家博物馆

无论如何,社会和个人责任应该分清楚。“上帝的事情上帝负责,凯撒的事情凯撒负责。”个人也不能把所有的责任推到政府方面,该自己承担的责任,比如个人卫生、遵守规则、家长责任,还是应该主动、积极承担起来。

全社会都应该关心下一代,但前提是家长自己先要负责。在孩子教育这件事上,不能家长什么事都不做,一心指望社会与政府。毕竟,冒用成人注册游戏账号这件事太容易被发现了。平台发现了潜在的冒用,就可以通过短信等方式通知家长。但通知之后怎么办,就是家长的工作了。因为一些家长的不负责,在游戏等问题上滥用人脸识别,有必要吗?

对游戏认证上人脸识别,潜在的负面影响就是,产生一种错误的观念:既然防止熊孩子打游戏这件既不迫切、又不紧急、没有危险的事情都可以上人脸识别;其他成千上万的家长自己可以解决的问题,也都可以不做,而要求几十万、几百万的其他人被人脸识别,那就没有什么事不可以上人脸识别了,也没有什么不可以用技术监管了。于是,人们逐渐放弃自己的自主性与责任,动动手指、点点屏幕,把一切交给技术,交给“管理者”。

17次人脸识别的新闻,居然没有引起舆论场一丝一毫的不适感。

这或许是更危险的。

原标题:《60岁老太“半夜玩游戏”被17次人脸识别,危险何在?》