IT技术网消息,近日英伟达推出了一种新的跨规模技术 Spectrum-XGS 以太网,旨在连接多个数据中心,形成一个统一的“人工智能超级工厂”。

Nvidia Spectrum-XGS 在 Hot Chips 2025 上亮相,作为满足代理 AI 资源需求的解决方案而推出,代理 AI 是代表企业自主执行任务的日益流行的 AI 模型。

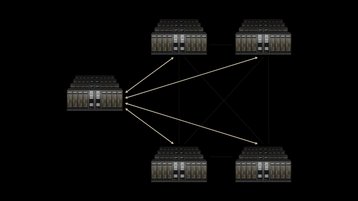

使用 Nvidia Spectrum-XGS 连接分布式 AI 数据中心

英伟达加速计算事业部加速计算产品总监戴夫·萨尔瓦托(Dave Salvator)表示,对于当今的网络来说,人工智能代理推理的增加已经不仅仅是一个多GPU和多节点的问题。

“大规模为许多用户提供出色的体验是一项大规模的挑战,”Salvator 说。

“现有数据中心或传统数据中心可能具有固定的功率预算,这意味着您可以在该数据中心获得相当数量的计算——但就您可以进入的功率量以及在某些情况下,您可以排出的热量方面可能会达到极限。”

Nvidia 的 Spectrum-XGS 建立在 Spectrum-X 之上,Spectrum-X 是这家科技巨头专为人工智能设计的基于以太网的网络结构。

Spectrum-X 内部:Nvidia 的以太网网络平台

Nvidia 如何重新设计以太网,为全球最大的 AI 集群提供动力

Spectrum-X 于 2024 年首次亮相,将 Nvidia 的网络硬件和软件融合到一个人工智能调优平台中,将基于 Spectrum-5600 架构构建的 Spectrum SN4 交换机与 BlueField-3 DPU 配对,将生成式 AI 网络性能提高到传统以太网结构的 1.6 倍。

Spectrum-XGS 标志着 Nvidia 以太网产品的下一次发展,Salvator 概述了一种新的网络算法利用 Spectrum-X 基础设施来实现站点之间更远距离的数据有效移动。该解决方案将 Nvidia Spectrum-X 交换机与 ConnectX-8 SuperNIC 集成在一起,ConnectX-8 SuperNIC 是该公司以 AI 为中心的 800 Gb/s 网络适配器。

Nvidia 声称新的 Spectrum-XGS 的性能几乎是开源 Nvidia 集体通信库 (NCCL) 的两倍,从而促进了 Nvidia GPU 之间的高速通信。

这家芯片巨头还声称,新的网络平台在多租户、大规模人工智能环境中提供的带宽密度是标准以太网的 1.6 倍。

Salvator 将最终结果描述为允许不同的数据中心相互通信并“本质上充当一个巨大的 GPU”,或者用 Nvidia 的话来说,是一个 AI 超级工厂。

术语“横向扩展”用于描述该方法,作为对现有纵向扩展和横向扩展架构的补充。

“我们现在正在谈论多数据中心规模,作为一种推动因素,让更雄心勃勃的代理人工智能应用程序达到他们需要的规模,”Salvator 说。

随着该版本的发布,Nvidia 正在加倍使用以太网作为 AI 工作负载的首选媒介。

正如 SDxCentral 最近报道的那样,Nvidia 试图充分利用 InfiniBand 并将其应用于以太网的 Spectrum-X 产品。

据 650 Group 称,英伟达的以太网增长使这家芯片巨头成为“2024 年数据中心交换领域增长最快的供应商”。

虽然 InfiniBand 在 2023 年仍占据了大约 80% 的 AI 后端网络市场份额,但 Dell'Oro Group 最近的预测表明,对基于以太网的解决方案不断增长的需求可能会在未来五年内产生近 800 亿美元的数据中心交换机收入。

据研究人员称,大多数网络工程师对以太网比对 InfiniBand 更满意,而将无数 GPU 连接在一起的高成本最终将使天平向有利于以太网的方向倾斜。