在企业级IT 架构的演进中,流量入口的稳定性从未像今天这样,与核心业务的生存线紧密相连。当证券公司的极速交易系统因网关重载(Reload)引发毫秒级延迟,这不仅是性能抖动,更是真金白银的交易损耗;当三甲医院的 PACS 影像系统因网关配置错误导致急诊数据调阅失败,这已超越了技术故障的范畴,升级为重大的医疗合规与业务连续性风险 。

在Kubernetes 发展的第一个十年里,Nginx-Ingress 凭借其成熟的内核与庞大的生态,成功支撑了微服务架构从 0 到 1 的平稳落地,成为行业事实上的默认标准 。然而,随着企业数字化转型步入深水区,尤其是面对以弹性伸缩、实时推理与确定性响应为核心诉求的新一代 AI 基础设施,Nginx 这种源于 Web 2.0 时代的“静态配置”模式,已逐渐触及架构治理的天花板 。

本文将站在甲方决策者的视角,跳出单纯的工具对比,深入审视Nginx-Ingress 的“时代边界”,并推演云原生网关从单一的“反向代理”向具备感知与自愈能力的“流量操作系统”进化的必然逻辑 。

1. 风险与成本:重新审视 Nginx-Ingress 的治理瓶颈

在甲方大规模生产环境中,SLA(服务等级协议)不仅是运维指标,更是对业务的承诺。任何非预期的架构“抖动”,本质上都是对 SLA 的直接侵蚀。我们必须正视 Nginx-Ingress 架构在处理现代化负载时,与云原生理念天然冲突的三个关键维度 。

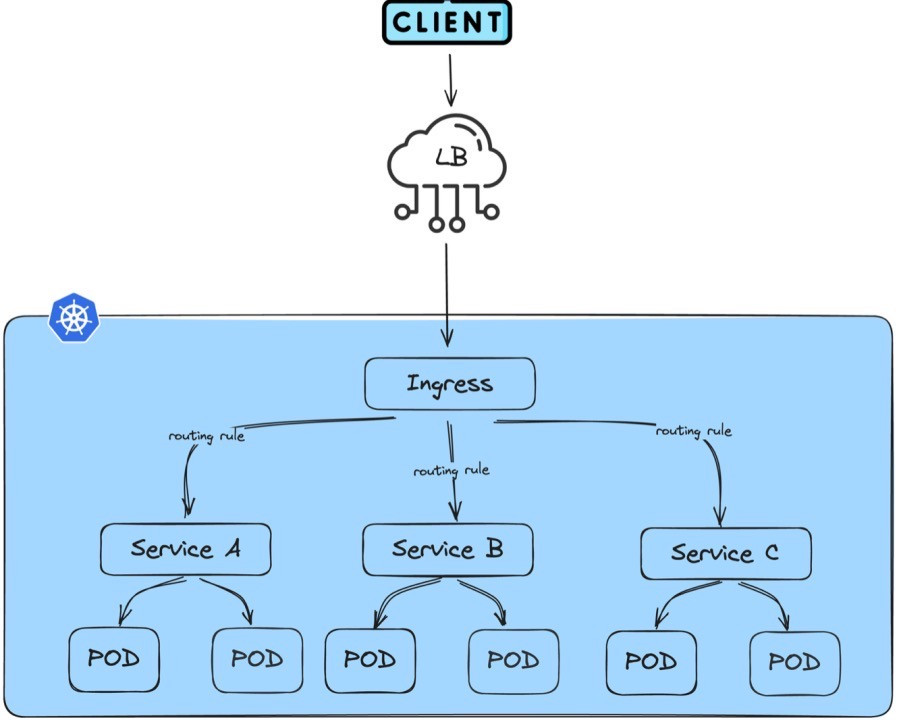

Nginx I ngress 架构可参考如下图所示:

本质上, 作为 Kubernetes 对外部流量接入的一种协议标准化,Ingress 屏蔽了底层负载均衡器的物理差异。但在万卡集群或超大规模微服务场景下,这种抽象层正面临 “ 性能 ” 与 “ 架构约束 ”层面 的双重挑战。

1.1 Reload 机制冲突:长连接场景下的 SLA 性价比悖论

在 Kubernetes 动态环境中,后端 Endpoint 的变动(如 Pod 的自动扩缩容、应用的滚动更新)已成为秒级发生的高频事件 。Nginx 传统的 nginx -s reload 机制,其核心逻辑在于 Fork 新进程以加载新配置,而旧进程必须处理完残余请求后才能退出。

在 AI 推理、WebSocket 等长连接业务场景中,这种机制会导致旧进程因连接无法释放而长期驻留,进而引发内存占用的阶梯式暴涨 。

更为严峻的是,频繁的进程切换会造成 CPU 抖动与连接重置,据实测,这可能导致约 0.8% 的长连接闪断风险 。对于那些计费敏感、追求 99.99% 推理 SLA 的核心业务平台而言,这种源自架构底层的损耗,已成为系统稳定性中最大的不可控变量,并直接转化为云资源成本的无效增长 。

1.2 Annotation 泛滥:合规性与审计的“语义塌陷”

由于 Ingress API 设计之初的语义能力极其有限,为了满足复杂的生产治理需求,大量的路由策略、重写规则乃至安全配置被强行塞入了 Annotation中 。

以某头部券商的实际生产环境为例,其单个 Ingress 资源平均包含 14.7 条 Annotation,且混杂了 Nginx、Traefik 及自研插件三套完全不同的语法体系 。

这种“非结构化”的配置手段,导致了严重的“语义塌陷”:配置字段缺乏类型校验,无命名空间隔离,且极难进行自动化审计 。

在金融、医疗等强监管行业,这种不透明的配置方式直接挑战了内部控制与合规审计的底线。系统配置从规范的“基础设施即代码(IaC)”退化为脆弱的“基础设施即注释”,极易因一次简单的拼写错误引发全局性的生产事故 。

1.3 静态内核依赖:研发与运维解耦的“爆炸半径”

Nginx 的模块化扩展属于典型的“编译期扩展”模式,这意味着任何功能的演进都必须发生在软件构建阶段,而非运行阶段 。

当甲方业务侧需要定制特定的能力,例如针对 AI 协议的特定校验或国密算法的加解密支持时,不得不对网关进行二进制级别的重新编译与发布 。

这种模式不仅极大地拉长了研发周期,更将业务逻辑与平台稳定性强耦合:一旦定制插件存在逻辑漏洞,极易导致整个网关进程崩溃,其故障的“爆炸半径”将波及所有共用该网关的业务,严重制约了业务敏捷创新的能力 。

2. 范式重构:新一代架构对甲方核心诉求的响应

甲方企业架构演进的视角来看,网关的迭代本质上是企业对“业务连续性”与“治理精细度”追求的必然结果。

针对上述架构痛点,以 Envoy 为核心的数据面配合 Gateway API 的演进方案,实现了网关从“静态指令执行”向“声明式意图驱动”的范式跨越 。

2.1 xDS 流式控制面:实现确定性的 SLA 承诺

在甲方的大规模生产环境中,任何“进程重启”或“配置重载(Reload)”都是潜在的 SLA 风险点。Nginx-Ingress 的局限性在于其耦合了配置解析与转发平面。

下一代云原生网关彻底废弃了“配置文件”这一物理中转层,转而采用基于 gRPC 的 xDS 协议,在控制面与数据面之间建立长连接 。

当后端的 AI 模型实例发生扩缩容时,变更指令以“流”的形式实时下发,Envoy 在内存中以原子操作更新负载均衡表,全程无需重启进程或重新解析文件 。

这种“在线热更新”机制从根源上消除了 Reload 引起的 CPU 抖动与连接闪断,为企业达成 99.95% 以上的 AI 服务 SLA 提供了坚实的底层确定性保障 。

2.2 Wasm 插件体系:安全隔离下的业务自治

此外,在甲方的技术治理中,如何平衡“通用网关”与“业务特有逻辑”也是始终面临的一个技术难题。比如,若需在 Nginx 层面增加逻辑(如特定 AI 协议的 Token 校验),必须编写 C 语言模块并重新编译二进制镜像。这不仅研发周期长,且一旦插件崩溃,整个网关进程都会随之宕机,爆炸半径极大。

通过引入 WebAssembly (Wasm) 架构,新一代网关构建了一个高性能的隔离沙箱 。

甲方业务团队可以使用 Go、Rust 等高级语言独立开发治理逻辑(如 Token 级的精细化流控、内容安全审计),并动态注入到网关中 。

由于 Wasm 插件运行在独立的沙箱内,即便插件逻辑崩溃,受损的也仅是单个请求的上下文,网关的核心转发进程依然稳如泰山 。这种架构彻底解耦了平台运维与业务研发的发布周期,在保障核心稳定性的同时,极大加速了智能体等创新业务的试错与迭代效率。

3. 标准统一:基于Gateway API 定义的治理秩序

在大型企业的架构演进中,Gateway API 的出现并非仅仅是 Ingress 的功能升级,而是一场关于“治理主权”的范式革命。

对于金融机构、互联网中心等拥有复杂组织结构的“甲方”而言,传统的 Ingress 资源本质上是一个单体配置模型。当基础设施运维、信息安全和业务开发三个部门被迫在同一个 YAML 文件中通过相互冲突的 Annotations 争夺控制权时,配置错误与生产事故便不可避免。Gateway API 通过资源模型的彻底重构,确立了云原生时代的流量治理秩序。

3.1 角色导向的资源模型:从“单体配置”到“解耦编排”

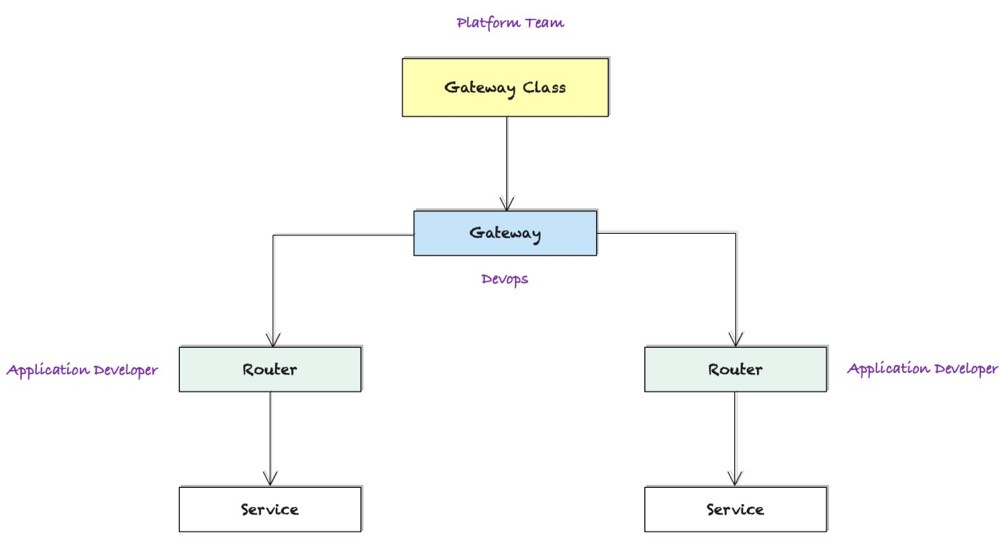

Gateway API 核心设计的精髓在于其对“职责分离”的深刻解构,将原先臃肿的流量入口定义拆分为层级明确的 CRD(自定义资源),这不仅是技术层面的解耦,更是对企业行政边界在技术实现上的精准映射。

具体架构可参考下图所示:

-

GatewayClass:基础设施的“抽象模板”

定义者:基础设施架构师或平台工程团队。

架构内涵:该层级屏蔽了底层实现的复杂性。决定了流量入口是基于高性能硬件负载均衡器(如 F5、DPDK 加速网关),还是基于公有云厂商的特定实现(如 AWS ALB、阿里云 MSE)。

核心价值:甲方只需定义一套标准,即可实现跨云环境的底层一致性,消除了对特定供应商 Annotations 的深度绑定。 -

Gateway:平台运维的“实例主权”

定义者:集群管理员或 SRE 运维团队。

架构内涵:在 GatewayClass 的基础上,运维团队定义具体的入口实例。这里是处理域名解析、TLS 证书挂载、端口暴露策略以及全局网络安全审计的核心阵地。

核心价值:运维团队可以独立于业务逻辑,专注于网关的生存周期与安全性,确保流量“大门”的坚固。 -

HTTPRoute / GRPCRoute:业务开发的“逻辑自治”

定义者: AI 业务团队或应用微服务开发者。

架构内涵:开发者无需关心底层的网络拓扑或证书配置,只需通过引用(ParentRef)指定的 Gateway,定义自己的转发规则。在 AI 推理场景下,这包括了精准的 Header 匹配、金丝雀发布权重、甚至是针对 LLM 模型的 Token 级流控策略。

核心价值:实现了“流量配置的自助服务”。业务团队可以高频更新灰度策略,而无需请求运维团队修改全局网关配置,极大缩短了业务迭代的闭环路径。

3.2 治理深度的跃迁:声明式语义与 RBAC 的闭环

在传统的 Ingress 模式下,权限控制往往是“全有或全无”。而 Gateway API 天然支持 Kubernetes 的 RBAC(基于角色的访问控制),具体体现在如下2个层面:

- 细粒度权限管控

企业的安全团队可以严格限制业务研发只具备 HTTPRoute 的修改权限,禁止其触碰敏感的 Gateway TLS 配置。 - 跨命名空间的引用能力

这允许企业建立一个统一的“公共网关命名空间”,各业务团队在各自的命名空间下定义路由规则并安全地挂载到公共网关上。这种架构既保证了入口的集中管控,又保留了业务的分布灵活性。

因此, 对于正在构建基于大模型驱动的业务系统的甲方而言,Gateway API 的标准化带来了两个决定性的收益:

- 消除“Annotation 丛林”

将过去隐藏在 Annotations 里的黑盒逻辑(如重写规则、重试机制、跨域策略)转化为 “ 类型安全 ” 的标准 API 字段。这意味着配置可以在下发前通过 Webhook 进行严格校验,从源头杜绝了因拼写错误导致全量网关瘫痪的风险。 - 平滑的架构迁移

由于 HTTPRoute 是标准化的,当企业决定将数据面从 Nginx 迁移至 Envoy(如 Higress)或未来更先进的 eBPF 实现时,业务层的配置无需任何变动。这种“配置资产的持久性”是大型企业在技术选型时最重要的护城河。4. 对甲方企业的实施启示与趋势展望

云原生网关的演进,本质上是服务于企业对“高可用运维”、“组织治理”等共性课题的深度探索 。

对于甲方决策者而言,架构升级不必一蹴而就。建议采取“敏稳双轨并行”的策略:

敏态业务:对于大模型应用、智能体等对延迟敏感、迭代极快的业务,建议先行接入 Envoy + Gateway API 架构,以第一时间获取毫秒级时延优化与业务自治红利 。

稳态核心业务:对于交易、清算等核心存量业务,则需在充分评估迁移复杂度后,制定平滑过渡计划。

虽然引入新架构涉及一定的学习曲线与迁移成本,但其带来的长期收益是显著的。这不仅体现在因故障率降低而直接节省的 TCO(总拥有成本),更体现在“配置资产的持久性”上——即当底层数据面从 Nginx 切换至 Envoy 或未来基于 eBPF 的技术时,上层的业务路由配置无需任何更改 。这是大型企业构建技术护城河的关键资产。

因此,从某种意义上而言,以 Envoy + Gateway API 为底座的下一代网关,已不再是简单的流量入口,而是演进为一套具备全链路感知、自愈能力与硬件加速支持的“流量操作系统” 。

对于追求极致效能与确定性技术主权的甲方企业而言,这一架构演进已不再是“可选项”,而是支撑万卡集群、降低毫秒级时延、保障 AI 业务连续性的“必经之路” 。在这个智能生命体架构中,网关将成为整个 AI 业务网络的中枢神经,向下链接物理算力边界,向上感知业务意图,最终实现架构治理能力的全面跃迁 。

参考:

- https://traefik.io/glossary/kubernetes-gateway-api

- https://www.solo.io/blog/what-is-ai-gateway

- https://realz.medium.com/an-introduction-to-envoy-ai-gateway-8553b6202bbf

本文作者:Luga Lee 首席架构师schedX.ai